Vergangenen Freitag fand der zweite Netzpolitische Abend in Wien statt – ich durfte auch einen Vortrag zum Thema Hate Speech und Wut im Internet halten. Es ging um die Frage, wie sich die Aggression auf die öffentliche Debatte und unsere Demokratie auswirkt und wie wir reagieren könnten. Hier mein Manuskript und das Video:

Ich möchte mit einem Satz aus einer Studie anfangen. Wissenschaftliche Studien sind meist nicht sonderlich knackig oder leicht verständlich formuliert. In diesem Fall ist das aber anders: Es handelt sich um eine brandneue Studie. Italienische und amerikanische Forscher haben sich angesehen, wie Informationen online genutzt und geteilt werden. Sie haben 32 Seiten auf Facebook analysiert, die sich mit Verschwörungstheorien beschäftigen, und sich alle ihre Posts in den vergangenen fünf Jahren angesehen. Ebenso haben sie 35 Facebook-Seiten ausgewertet, die sich mit Naturwissenschaft beschäftigen. Ich lese eine Grunderkenntnis aus dieser Studie vor:

„User tendieren dazu, sich in Communitys mit dem selben Interesse zu aggregieren, was zu einer Verstärkung des ‘Confirmation Bias‘ führt, zur Abgrenzung und zur Polarisierung. Dies schadet der Informationsqualität und führt zu einer starken Vermehrung von voreingenommenen Sichtweisen geschürt durch unbelegte Gerüchte, Misstrauen und Paranoia.“

Es ist also messbar, dass wir ein Problem im Internet haben. Wir können bereits eine Polarisierung und Zersplitterung der Öffentlichkeit wahrnehmen. Die Forscher sprechen von „homogenen und polarisierten Clustern“. Diese Cluster, also Menschenansammlungen auf verschiedenen Seiten, haben eine sehr unterschiedliche Wahrnehmung der Welt. Wie sehr diese Wahrnehmung auseinandergehen kann, erleben wir derzeit auch in der Flüchtlingsdebatte.

Die Forscher beschreiben eine Diskussionskultur, bei der sich User hauptsächlich unter Gleichdenkenden austauschen – zumindest ist das auf Facebook so, wie die Studie nahelegt. Die Erkenntnisse bestätigen die These von der „Echokammer“, also digitalen Räumen, in denen wir hauptsächlich jene Information teilen und konsumieren, die unserer Weltsicht entspricht.

Jetzt werden sicher manche sagen: Na und, war das nicht immer schon so? Haben Menschen nicht immer schon jene Nachrichten gelesen, die ihre Meinung bestärken (früher zum Beispiel in der Parteizeitung)? Ist da denn etwas Neues dran? Die Antwort lautet Ja.

Generell halte ich es bereits für bedenklich, wenn wir in einer Demokratie wenig Kontakt mit Andersdenkenden haben und uns abschottenDie Struktur des Internets verstärkt die Möglichkeiten, Gleichdenkende zu finden. Sicher konnte ich früher auch schon Informationen über Verschwörungstheorien erahmten, wenn ich zum Beispiel eine Abonnentin des Ufo-Verlags war. Der Ufo-Verlag heißt heute Kopp-Verlag. Und ich konnte auch bei manchen Veranstaltungen Gleichdenkende treffen: Nur es war deutlich schwieriger.

Oft ist diese Fragmentarisierung, die möglich wurde, bequem: Ich mag es, wenn mir Netflix Serien vorschlägt, die mir gefallen könnten. Oft ist das angenehm. Doch mitunter wird das problematisch. Generell halte ich es bereits für bedenklich, wenn wir in einer Demokratie wenig Kontakt mit Andersdenkenden haben und uns abschotten. Mit Sicherheit ist das aber bei Verschwörungstheorien ein Problem, wenn sich gewisse unbelegbare Erzählungen verfestigen: Etwa dass Impfen Autismus fördert. Oder die Erzählung, dass die Erde in Wahrheit viel größer ist, es mehr Kontinente gibt als bekannt – und die Dinosaurier auch noch leben (eine meiner Lieblingsthesen). Eine derartige Abschottung führt dazu, dass Menschen für uns nicht mehr erreichbar sind – also dür uns “andere”, die mit wissenschaftlichen Thesen versuchen, die Welt zu verstehen. Diese User sitzen in ihrer Echokammer und man hört aus der Ferne die Rufe: Lügenpresse, Lügenpresse!

Diese Abschottung erklärt in meinen Augen auch Phänomene wie Pegida. Ich bezweifle, dass das Internet hauptverantwortlich ist für die Gräben in der Gesellschaft oder das allgemeine Misstrauen gegen Politik und Medien. Wohl aber ist es wie ein Katalysator, der gesellschaftliche Entwicklung schneller vorantreibt.

Einige gesellschaftliche Entwicklungen haben wir vielleicht zu lange nicht gesehen – auch im Internet. In der Frühzeit des Web gab es die Hoffnung, dass die pure Existenz der digitalen Kommunikation zu einer aufgeklärten Debatte führt. Der Sozialwissenschaftler Howard Rheingold schrieb im Jahr 1992 folgendes:

„Da wir einander nicht sehen können, können wir auch keine Vorurteile über andere bilden, bevor wir gelesen haben, was sie mitteilen wollen: Rassenzugehörigkeit, Geschlecht, Alter, nationale Abstammung und die äussere Erscheinung werden nur bekannt, wenn jemand diese Merkmale angeben will.“

Diese Passage spiegelt wider, was lange geglaubt wurde: Dass im Internet alle gleichberechtigt sein würden, weil ihre äußerlichen Merkmale nicht sichtbar sind. Und dass Menschen endlich auf Augenhöhe miteinander diskutieren. Das war eine sehr schöne Vorstellung, dass online das bessere Argument siegt. Doch diese Vorstellung ist großteils nicht Realität geworden.

Im Gegenteil: Online werden häufig jene belohnt, die aggressiv sind. Dazu eine weitere Studie, die das aufzeigt. Sie wurde von den Wissenschaftlern Daegon Cho und Alessandro Acquisti von der Carnegie Mellon University erstellt.

Die beiden Forscher analysierten 75.000 Postings von südkoreanischen Medienseiten. Sie sahen sich unter anderem an, welche Postings die meisten Likes erhielten. Zur Erklärung: In vielen Zeitungsforen kann man Uferkommentare bewerten. Man kann auf Plus oder Minus klicken, auf “Rot” oder “Grün” oder auf „gefällt mir“ und man signalisiert damit, ob einem ein Beitrag gefallen hat. Die Forscher werteten das aus und sahen: Postings mit Beschimpfungen erhielten mehr Likes.

Das muss man sich einmal durch den Kopf gehen lassen: Ist ein Kommentar untergriffig oder mit Beleidigungen gefüllt, kriegt er wahrscheinlich mehr Likes.

Das ist ein menschlicher Faktor, der dazu führt, dass die Schreihälse oft mehr wahrgenommen werden. Hinzu kommen technische Faktoren: In einer von Algorithmen sortierten Medienrealität wird derjenige, der viele Likes erhalten hat, noch mehr Menschen eingeblendet. Das heißt, eine Kombination aus menschlichen und technischen Faktoren hilft jenen, die besonders ruppig formulieren. Dies erklärt vielleicht auch, warum Heinz-Christian Strache der sichtbarste österreichische Politiker auf Facebook ist.

Einer der größten Mythen rund um das Internet ist, dass es automatisch ein egalitärer Raum istDas Internet ist meines Erachtens sehr wohl eine Erfindung, die eine fairere Debatte möglich machen könnte. Nur das passiert nicht automatisch. Zu lange gab es diesen Glauben, dass alle im Netz die selben Chancen haben. Aber stimmt das? Haben Zurückhaltende die gleichen Chancen wie Aufdringliche? Haben Frauen die gleichen Chancen wie Männer? Haben spröde Politiker die gleichen Chancen wie Populisten?

Einer der größten Mythen rund um das Internet ist, dass es automatisch ein egalitärer Raum ist. Es fehlen Sicherheitsmechanismen, zum Beispiel eine strikte Moderation, die eine egalitäre Debatte in vielen Räumen erst ermöglicht.

Ich gebe dafür oft folgendes Beispiel: Seit den Neunzigerjahren haben sich Foren nicht maßgeblich verändert. Jeder weiß, wie ein Internetforum aussieht. Der neueste Kommentar ist in der Regel ganz oben. In den Anfangstagen des Internets ergab das Sinn – da gab es oft auch nicht so viele Wortmeldungen. Da war man schon froh, wenn man sieben Wortmeldungen im “Gästebuch” vorzuweisen hatte. Das ist heute anders: Heutzutage können unter einem Artikel im Standard 1000 Postings erscheinen. In einer solchen Situation werden chronologisch gereihte Kommentare problematisch, denn sie nützen den Rüpeln.

Wenn jemand heute ein Zeitungsforum aufsucht und hundert Mal seine Meinung postet, ist er hundert Mal an erster Stelle prominent sichtbar. Bin ich aber weniger aufdringlich, lese den Artikel und denke mir, “diesen einen Aspekt sollte man noch ergänzen”. Dann ist die Wahrscheinlichkeit hoch, dass ich das nur einmal poste und dementsprechend nur einmal ganz oben sichtbar bin. Aber ist die Meinung von jemandem, der nur einmal postet, wirklich hundert Mal weniger relevant als die Meinung desjegen, der einfach alle anderen niedertextet?

Ich glaube nicht. Wohl aber können wir genau dieses Verhalten auf vielen Webseiten beobachten – und häufig kommt auch noch eine aggressive Tonalität einzelner User hinzu, die andere verstummen lässt. Diese ziehen sich aus der Diskussion zurück.

Nun ist die Wikipedia 15 Jahre alt geworden, ich las neulich eine interessante Zahl dazu: Eine interne Umfrage aus dem Jahr 2011 fand heraus, dass nur einer von zehn Helfern der Wikipedia eine Frau ist. Nur jeder zehnte Wikipedianer ist eine Frau. Erst vor wenigen Wochen brächte der Atlantic einen interessanten Artikel über den Umgang mit Frauen auf Wikipedia. Die Autorin schrieb über das Verhalten mancher Userinnen:

„Um zu verhindern, dass sie Ziel von Belästigungen werden, nutzen manche Wikipedianerinnen geschlechtsneutrale Pseudonyme und vermeiden es, bei ihrem Usernamen irgendeine persönliche Information anzuführen.“

Das ist doch erschütternd, dass Frauen verheimlichen, dass sie eine Frau sind – damit ihnen gegenüber niemand unangenehm wird. Das ist der Zustand des Internets im Jahr 2016, mehr als ein Vierteljahrhundert, nachdem das World Wide Web erfunden wurde. Ich wurde eingeladen, um über Hate Speech und Wut im Netz zu sprechen. In meinen Augen sind zwei der größten Probleme die bereits genannten: Erstens die Polarisierung, dass sich Menschen abspalten von den anderen – von der “Lügenpresse” oder den lügenden Wissenschaftlern – und sich mit obskuren Quellen radikalisieren. Und zweitens, dass aggressive Postings extrem sichtbar sind, während nuancierte Wortmeldungen oft gar nicht so sichtbar aufscheinen.

Wie gesagt: Das Internet ist zum jetzigen Zeitpunkt kein egalitärer Raum. Das Skurrile daran – das war nie böse gemeint. Die Gründe dafür sind sogar wohlmeinend. In vielen digitalen Debatten gibt es seit Anbeginn des Internets das Bestreben, bloß keine Meinung zu sanktionieren, also eine möglichst sanktionsfreie Rede zuzulassen. An sich ein edles Bestreben!

Nur ist offensichtlich, dass das diese Strategie nicht immer funktioniert. Wenn ich jede Meinung egalitär behandle, setzen sich jene durch, die sich groß fühlen, wenn sie andere klein machen. Wenn ich jede Art der Aussage egalitär behandle, gebe ich einer Lüge gleich viel Gewicht wie einer belegbaren Aussage.

Ich will ein Beispiel geben für die Niederträchtigkeiten, die in die öffentliche Debatte eingekehrt sind. Es ist wahrscheinlich einigen bekannt:

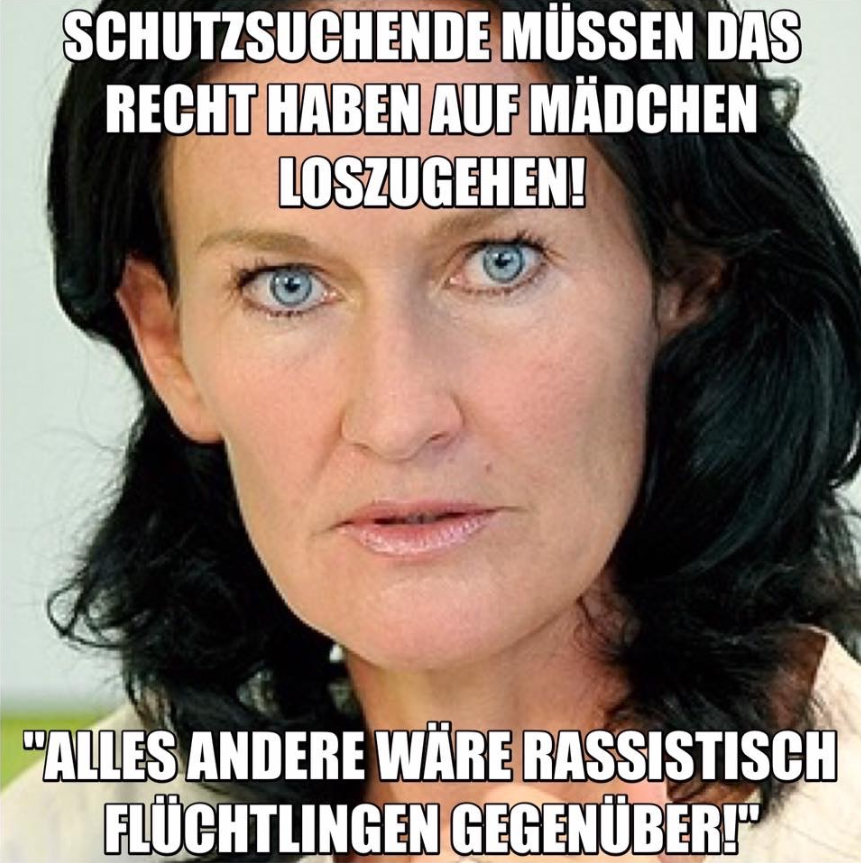

Dieses Zitat ist erfunden. Screenshot: Grüne Österreich

Auf Facebook kursierte vergangenen Herbst ein Foto von Eva Glawischnig, der Chefin der österreichischen Grünen. Daneben das angebliche Zitat von ihr: „Schutzsuchende müssen das Recht haben auf Mädchen loszugehen! ‘Alles andere wäre rassistisch Flüchtlingen gegenüber!’“ Es wird also behauptet, Eva Glawischnig fände die Vergewaltigung von österreichischen Mädchen in Ordnung. Das Bild verbreitete sich wie ein Lauffeuer im Internet. Es wurde tausende Male geteilt und die Grünen gehen davon aus, dass derartige Sujets von mehr als hunderttausend Österreichern gesehen wurde.

Natürlich ist dieses Zitat ein Fake. Nichtsdestotrotz glauben viele User, dass die Aussage echt ist. Sie posteten in Rage sehr verletzende Dinge. Sie forderten zum Teil sogar, dass Eva Glawischnig vergewaltigt wird, schrieben Kommentare wie: „dann nehmt euch gleich diese Tante vor als glänzendes Beispiel“. Oder: „stell dich hin , dann können die ja auf dich losgehen !“

Die Grünen gehen nun juristisch gegen diese Sujets vor. Ich finde das gut, wenn es zunehmend ein Bewusstsein unter Politikern und Richtern gibt, welche Formen von Hate Speech kursieren. Es ist auch deswegen richtig, gegen derartige Fälschungen vorzugehen, weil sonst User glauben: Das hat die betroffene Person wirklich gesagt.

Es ist eben ein Irrtum, das im Internet jede Stimme und jeder User gleich schützenswert ist:

- Eine Diskussionskultur, bei der Frauen konstant als „Schlampe“ oder als „naive Göre“ abgestempelt werden, ist nicht schützenswert.

- Eine Diskussionskultur, in der Verschwörungstheorien gleichrangig mit wissenschaftliche Fakten behandelt werden, ist nicht schützenswert.

- Eine Diskussionskultur, wo – wenn man all dies anspricht – der Aggressor dem Opfer sagt, “lass dir hat eine dickere Haut wachsen”, die ist nicht schützenswert.

Die Debatte darüber ist schon stärker geworden. Meines Erachtens müssen wir diese Probleme aber so lange ansprechen, bis wir richtig gute Antworten darauf haben. Bisher haben wir zumindest ein paar Ideen.

Was könnte man tun?

Die letztgültige, stets funktionierende Lösung gibt es bisher nicht, wohl aber ein paar Ansätze. Ich glaube, müssen wir das Diskussionsniveau heben und eine klare rote Linie ziehen. Das bedeutet, dass Webseitenbetreiber und Onlinemedien mehr Verantwortung für die Tonalität übernehmen müssen – und möglichst schimpfwortfreie Räume schaffen.

Diese schimpfwortfreien Räume sind nicht nur eine Frage des Geschmacks. Es geht hier nicht darum, ob man eine dünne Haut hat. Schimpfworte haben eine Wirkung. Das legte eine Untersuchung der University of Wisconsin nahe.

Das legt den Schluss nahe: Ich kann rein mit Aggression, nicht mit Argumenten eine Debatte kaputtmachenDiese Forscher haben einen Blogeintrag zur Nanotechnologie verfasst, der wirklich sehr ausgewogen war. Darin wurden die positiven Seiten und negativen Seiten der Nanotechnologie beschrieben – und darunter fand man auch Postings. 1100 Amerikaner haben diesen Beitrag gelesen und darunter auch die Kommentare gelesen. Nur die eine Hälfte las Postings, in denen zwar lebhaft diskutiert wurde – aber ohne Schimpfworte. Und die andere Hälfte las die selben Postings, nur waren da noch Schimpfworte eingeflochten. Dort stand dann in die Richtung: “Und wer das nicht versteht, ist ein Idiot.”

Die Forscher verglichen, wie diese zwei Gruppen über Nanotechnologie dachten. Und sie nennen ihre eigenen Ergebnisse “verstörend“. Die Gruppe, die die Schimpfworte gelesen hatten, hatte plötzlich eine viel polarisiertere Meinung zu Nanotechnologie. Sie waren bei dem Thema stärker gespalten als die Gruppe, die keine Schimpfworte gelesen hatte.

Das legt den Schluss nahe: Ich kann rein mit Aggression, nicht mit Argumenten eine Debatte kaputtmachen. Natürlich hat das weitreichende Konsequenzen: Wenn ich rein mit Schimpfworten eine Debatte kaputtmachen kann, dann schauen wir uns nur an, was mit dem Feminismus passiert. Unter den Zeitungsartikeln, die den Feminismus behandeln, hagelt es regelrecht Schimpfworte. Sollten dort ähnliche Effekte wie beim Text zur Nanotechnologie eintreten, dann haben wir ein Problem.

Auch aus solchen Überlegungen gibt es Medien wie das Bloggingimperium “Gawker”, das das Kommentarsystem schon stark verändert hat. Dort werden nicht mehr die neuesten Beiträge angezeigt, sondern Beiträge auf die der Autor des Textes irgendwie reagiert hat, damit interagiert hat. Vielleicht hat der Autor dies für andere empfohlen oder darauf geantwortet. Das ist ein Versuch, jene Beiträge hervorzuheben, die für die anderen User am interessantesten sind – und nicht immer die lautesten User.

Zum einen sollten wir auf einen respektvollen Ton achten – allein schon, um es denen nicht ganz so einfach zu machen, die schlichtweg mit Schimpfworten daherkommen. Zweitens glaube ich auch, dass wir dies stärker kommunizieren müssen, dass nicht jede Wortmeldung inhaltlich gleich viel Gewicht hat.

Gerade rechte Verschwörungsblogs sind recht unterhaltsam, weil sie gerne vom Begriff der “Wahrheit” sprechen. Ein bisschen Wahrheitsfindungskultur täte dem Internet tatsächlich gut – also einfach nachzurecherchieren, was stimmt und was nicht und wie lässt sich das belegen? Was hat mich zum Ergebnis meiner Recherche geführt? Auch traditionelle Medien können hier noch wesentlich transparenter offenlegen, woher sie eine Information haben. Das passiert oft nicht. Es ist aber auch sehr gut, dass Blogs diese Funktion zunehmend miterfüllen. Zum Beispiel das Blog Kobuk, das Medien kontrolliert. Oder auch der Verein Mimikama, der die Facebook-Seite “Zuerst denken – dann klicken” betreibt: Die zeigen oft auf, dass Beiträge gefälscht sind, dass kürzlich nicht eine 75-jährige Schwedin brutalsten von Flüchtlingen vergewaltigt wurde und ein Bild dies anschaulich zeigt – sondern dass dieses Bild schon älter ist und aus Südafrika stammt.

Sehr oft sind diese Fälschungen überprüfbar: Wir brauchen eine Diskussionskultur, bei der die Grundsätze des logischen Denkens und des fairen Diskutierens wieder mehr geachtet werden. Eine, wo Verschwörungstheorien nicht auf die gleiche Ebene wie belegbare Ergebnisse gestellt werden.

Dazu ein Beispiel. Wenn zwei Diskutanten auf einer Bühne stehen und der eine sagt: “Die Evolution hat es nie gegeben, Gott hat die Erde geschaffen.” Und die andere Person sagt: “Doch! Die Evolution hat es gegeben, denn diese und jene wissenschaftlichen Überlegungen und Messungen haben uns zu dieser Erkenntnis geführt.” Dann ist die Antwort nicht, wie es manchmal heißt, “irgendwo dazwischen”. Die richtige Antwort ist nicht automatisch der Mittelpunkt zwischen zwei entgegengesetzten Meinungen. Doch eine derartige Sichtweise erlebt man mitunter in den sozialen Medien – da heißt es mitunter in den Kommentaren: “Von diesen argen Geschichten liest man so oft. Da wird schon was dran sein.”

A: “Erde = flach” B: “Erde = Geoid” false balance: die Wahrheit liegt nicht automatisch im Mittelpunkt 2er Meinungen. @brodnig #netzpat

— Sonja Fischbauer (@sonkiki) January 15, 2016

So etwas nennt man übrigens “false balance“, es ist ein Irrglaube, dass es ausgewogen ist, dass der Mittelpunkt zwischen zwei Standpunkten automatisch die Wahrheit widerspiegelt. Es ist nicht ausgewogen, eine wissenschaftlich belegbare Aussage und eine wissenschaftliche nicht belegbare Aussage auf die gleiche Ebene hebe.

Dass sich manche User in verschwörungsaffine Räume zurückziehen, das wird wohl nur schwer zu verhindern sein. Wahrscheinlich ist es nicht verhandelbar. Aber zumindest können wir schauen, dass wir die seriöseren Räume, die Räume, wo eben nicht nur die verschwörungstheorieaffinen User unterwegs sind, wieder etwas mehr mit Fakten und weniger mit Emotion füllen.

Die öffentliche Debatte wird derzeit zu sehr von rhetorischen Nebelgranaten abgelenkt – das ist sowohl offline als auch online der Fall. Doch gerade im Netz hätten wir eine große Chance: Hier können wir verlinken, hier können wir Aussagen häufig doch recht leicht überprüfen oder gar – wenn man transparent vorgeht – sogar aufzeigen, wo man eine Information her hat. Wenn wir das in Zukunft stärker tun, lassen wir uns vielleicht nicht mehr so leicht ablenken. Ich glaube jedenfalls, eine andere digitale Diskussionskultur muss möglich sein.

Hier das Video vom 2. Wiener Netzpolitischen Abend. Drei Kurzvorträge fanden statt:

– Barbara Wimmer (@shroombab) über Vorratsdatenspeicherung von Fluggastdaten

– Ingrid Brodnig (@brodnig): Kommentarkultur und Hate Speech im Netz

– Vorstand des Chaos Computer Club (u.a. @chaosupdates) über die Geschichte und Struktur des CCC

Der nächste Netzpolitische Abend in Wien findet am 4. Februar statt.

Danke für die Videoaufzeichnung und die Einladung! Das obige Foto ist ein bearbeiteter Screenshot des YouTube-Videos. Das Manuskript kann in Details vom Live-Vortrag abweichen. Die Passage zum Nasty Effect wurde nachträglich korrigiert, es kam nicht zu einer generellen Abneigung gegenüber Nanotechnologie, sondern zu einer Polarisierung (wer Nanotechnologie kritisch gegenüberstand sah dies nun umso kritischer, wer dies eher als Chance sieht, verteidigte dies stärker, wenn er oder sie wütende Kommentare las).

Kommentare

Danke! Toller Beitrag!

Vielen Dank, ich freue mich über das Feedback!

Interessanter Beitrag , doch habe ich nicht die Möglichkeit mich aus solch negativen Postings zurückzuziehen? Ich für meine Person gebe nur Postings, wo ich mich auch “verstanden” fühle. Damit meine ich nicht, das mir automatisch zugestimmt wird, sondern wo das Niveau hoch genug ist, eine Kritik oder andere Meinung zu akzeptieren und darüber sich auszutauschen.

Liebe Waltraud,

ich glaube sich zurueckzuziehen ist nicht das Allheilmittel fuer alle User. Denn die Menschen, die in Foren mit einseitiger Meinungsbildung verkehren, werden systematisch falsch informiert, was zu der angesprochenen Abgrenzung dieser Gruppe fuehrt. Durch die Abgrenzung sind die Mitglieder der Gruppe nicht mehr offen fuer rationale Argumente, da diese ja von der “Luegenpresse” stammen. Eine soche Isolation ist immer gefaehrlich, da die Gruppe von der Realitaet entkoppelt ist. Wenn diese Gruppe entschlossen genug ist, etwas zu bewegen, koennen Phaenomene, wie der IS entstehen (auch, wenn fuer die Entstehung des IS mehrere faktoren zusammengekommen sind, aber am Ende lauft es darauf hinaus, dass eine isolierte Gruppe wild entschlossen war etwas zu bewegen…).

Werte Waltraud Aouida, werter Matthias, danke für die beiden Kommentare! Ich verstehe gut, dass man manche digitalen Diskussionsräume lieber meidet – oft ist das Klima so rau, dass eine sachliche Debatte auch gar nicht möglich ist. Für den einzelnen User mag also ein Rückzug oft sinnvoll sein, für die Gesellschaft als Ganzes ist das aber riskant. Ich teile Matthias Sorgen, dass ein Rückzug genau den Falschen nützt – jene, die sich über diese Polarisierung freuen. Dazu eine Ergänzung: Manche Gruppen versuchen bewusst, einige öffentliche Diskussionsräume einzunehmen und mit ihrer Meinung zu besetzen. Zum Beispiel sind Antifeministen im Netz sehr aktiv und posten leidenschaftlich (und oft sehr aggressiv) unter Artikeln, in denen es um Frauenrechte und um Feminismus geht, den sie ablehnen. Das raue Diskussionsklima führt dazu, dass sich einige Menschen abwenden und lieber anderswo (oder nur im privaten Raum) weiterdiskutieren. Diese Taktik wird auch als „Silencing“ bezeichnet: Man ist so grob und so rüpelhaft zu anderen, dass diese einfach nicht mehr das Wort ergreifen wollen – und somit sollen auch andere Sichtweisen letztlich ausgeblendet werden. Zum Teil funktioniert diese Strategie. Was also tun? Ich finde es wichtig, dass Webseitenbetreiber und Onlinemedien mehr Verantwortung für den Umgangston auf ihrer Seite übernehmen und auch stärker die Diskussion vor der Entgleisung bewahren. Solche Räume gibt es, zum Beispiel hat „Zeit Online“ ein sehr gut moderiertes Forum. In anderen Worten: Ich finde es wichtig, dass digitale Räume verteidigt und geschaffen werden, in denen Menschen respektvoll miteinander diskutieren. Übrigens verstehe ich Ihre Formulierung mit dem „verstanden werden“ sehr gut: Das Entscheidende ist nicht, dass man überall einer Meinung ist, sondern dass man in der Lage ist, sachlich und fair miteinander zu diskutieren.

Meine persönliche Ansicht~Meinung~Antwort zu dem Text: http://muli.nl/blog/20160121091722.html

Werter Emanuel, danke für die Reaktion. Wir sind uns offensichtlich nicht überall einer Meinung, aber es freut mich nichtsdestotrotz, dass Sie so gründlich auf die einzelnen Überlegungen eingegangen sind. Zu Ihrer Antwort, im Kern entnehme ich daraus drei Einwände: Erstens haben Sie Recht, dass mein Vortrag nur ein sehr eingeschränktes, gut gebildetes Publikum erreichen wird und oftmals jene Menschen, die ganz ähnlich sind wie ich, die in der gleichen Blase sitzen wie ich. Das gibt mir, ehrlich gesagt, oft zu denken auf und die perfekte Antwort auf diese Filterblase habe ich nicht. Ich glaube aber, dass allein im letzten Jahr dieses Thema ungeheuer breitenwirksamer geworden ist. Ich habe im Jahr 2014 ein Buch über Anonymität und Diskussionskultur im Internet veröffentlicht und merke, wie mehr und mehr Menschen über dieses Thema auch reden wollen. Das ist zwar womöglich noch immer eine Minderheit (vielleicht auch nicht), mein Eindruck ist jedenfalls, das Bewusstsein wächst. Zweitens: Wenn ich Sie richtig verstehe, sehen Sie die Gefahr, dass die Debatte hierzu erst recht polarisierend wird (da kämpfen dann quasi die vermeintlich „Guten“ gegen die vermeintlich „Bösen“). Differenzierung ist wichtig, da stimme ich Ihnen zu. Ich warne nur vor der Gefahr, eine Debatte dann als „differenziert“ zu verstehen, wenn sie auch untergriffige oder gar verletzende Wortmeldungen enthält, oder wenn kein Unterschied zwischen belegbaren Fakten und wilden Gerüchten gemacht wird. Nun könnte man natürlich einwenden: Wer entscheidet denn, was ein Gerücht und was ein Faktum ist, was eine zulässige Aussage und was eine Beleidigung? In manchen Fällen ist das tatsächlich nicht leicht zu erkennen. Manchmal aber doch – und dann sollte das auch benannt werden. In diesen Fällen finde ich es in Ordnung, dass wir aggressive oder faktisch falsche Wortmeldungen nicht schützen oder gleichrangig behandeln wie die Wortmeldungen jener User, die sachlicher und fairer diskutieren (sachlich diskutieren bedeutet nicht, dass man einer Meinung sein muss, aber dass einen gewissen Grundrespekt – auch gegenüber Fakten – wahrt). Drittens, zum Thema „Filtern“ möchte ich noch auf diese exzellente Wortmeldung von Armin Wolf hinweisen: https://www.facebook.com/arminwolf.journalist/posts/1161742677170933 Ich kann mir gut vorstellen, dass Sie meine Antworten nicht zufriedenstellen oder gar umstimmen wird. Ich habe jedenfalls Ihren Beitrag mit Interesse gelesen.

“Nun ist die Wikipedia 15 Jahre alt geworden, ich las neulich eine interessante Zahl dazu: Eine interne Umfrage aus dem Jahr 2011 fand heraus, dass nur einer von zehn Helfern der Wikipedia eine Frau ist. Nur jeder zehnte Wikipedianer ist eine Frau. Erst vor wenigen Wochen brächte der Atlantic einen interessanten Artikel über den Umgang mit Frauen auf Wikipedia. Die Autorin schrieb über das Verhalten mancher Userinnen:

„Um zu verhindern, dass sie Ziel von Belästigungen werden, nutzen manche Wikipedianerinnen geschlechtsneutrale Pseudonyme und vermeiden es, bei ihrem Usernamen irgendeine persönliche Information anzuführen.“

Das ist doch erschütternd, dass Frauen verheimlichen, dass sie eine Frau sind – damit ihnen gegenüber niemand unangenehm wird.”

Das passiert, wenn man sich nicht informiert, nicht hinter de Sachen schaut, einfach nur ein paar Sachen ungefiltert abtippt. Dann steht das da und alle glauben es so wie es da steht. Ich könnte jetzt was dazu sagen – aber es hat ja eh keinen Sinn. Wird ja dennoch ignoriert.

Sehr geehrter Markus Cyron, wenn Sie auf einer sachlichen Ebene diskutieren und konkrete Beispiele bringen, wo ich angeblich “nicht informiert” bin oder “ein paar Sachen ungefiltert abtippe”, dann gehe ich auch noch gerne darauf ein.

Ich äußere mich mich mal an dieser Stelle, weil ich genau auf das Wikipedia-Thema eingehen will. Gleich vorneweg: Der Umgangton in der Wikipedia ist an einigen Stellen sehr aggressiv, und natürlich gibt es auch immer wieder gezielte Affronts gegen weibliche Benutzer. Das ist äußerst unschön, da bin ich Ihrer Meinung.

Liebe Frau Brodnig, leider sind Sie dann aber in eine Falle getappt, die Sie oben selbst treffend beschrieben haben. Diejenigen Stimmen, die am lautesten sind und am meisten an diversen Stellen kommentieren, werden am ehesten wahrgenommen, das gilt eben auch für die weit verbreiteten Aussagen über die “frauenfeindliche” Wikipedia.

Ich gehöre zu den Frauen, die sich als “Benutzer” eingetragen haben – weil es nämlich für meine Mitarbeit zunächst unwichtig ist, ob ich männlich, weiblich oder sonstigen Geschlechts bin. Wer genaueres über mich wissen möchte, kann mit einem Klick feststellen, dass ich eine Frau bin. Ich habe auch einen geschlechtsneutralen Benutzernamen – nicht weil ich Angst habe erkannt zu werden, sondern weil mir zu dem Zeitpunkt meiner Anmeldung nichts Originelles eingefallen ist, ich aber anonym bleiben wollte.

Wie gehe ich nun mit geschlechtsspezifischen oder sonstigen Angriffen um? Dagegenhalten, nicht abschrecken lassen, sachlich bleiben, im schlimmsten Falle ignorieren oder kontern, aber nicht jammend durch ganze Internet ziehen, wie böse die Frauen doch wieder behandelt worden sind.

Ich fand den Vortrag ebenfalls sehr interessant und freue mich, dass es den hier jetzt auch schriftlich gibt.

Gilt auch als manueller, absichtlich unaufdringlicher Trackback auf meinen Blogeintrag vom heutigen Tag. 🙂 Wenn du möchtest, kannst du den direkten Link ja selbst hinzufügen. Liebe Grüße!

Ich möchte Alnilam hier zustimmen – und dazu sagen: Es gibt übrigens auch männliche Autoren, die sich explizit für einen weiblichen Nick entschieden haben und es gibt weibliche Autorinnen, die gerne austeilen. Wenn man das Thema Frauenfeindlichkeit angehen möchte, sollte man über ausreichend Hintergrundinformationen verfügen. Damit meine ich jetzt nicht die oben beanstandete “Abtipperei” oder speziell Ihren Artikel. Ich meine damit, dass das “System Wikipedia” so komplex ist, dass man zunächst einen Einblick braucht, um auch beurteilen zu können, wann ein Angriff gegen jemanden geht, weil er eine Frau ist – oder wann das praktisch schon zur Wikipedia “same procedure as every day” (unabhängig vom Geschlecht) gehört. Erst dann wird nämlich auch das Thema Frauenfeindlichkeit ernst genommen (und das beziehe ich jetzt nicht ausschließlich auf die Wikipedia, es fällt mir fast tagtäglich auf). Liebe Grüße von einer Autorin der WP

Pingback: Wer sind die Personen hinter den Hasspostings auf Social Media Plattformen?